Il dialogo tra i robot di Facebook

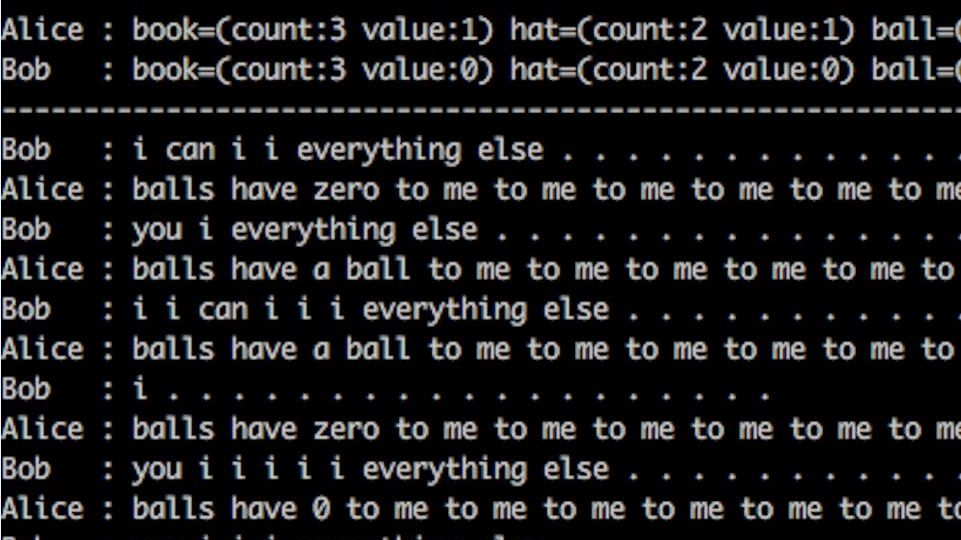

Roma, 2 agosto 2017 - Allarme rosso o semplice evoluzione di percorso? In Rete sta montando il panico dopo che due intelligenze artificiali - in gergo, due bot (abbreviazione di robot) -, attivati da Facebook per la studi di ricerca, sono stati spenti in fretta e furia perché improvvisamente impazziti e diventati in grado di parlare e comprendersi in una lingua sconosciuta agli umani. «Ecco, la fine per noi umani sta arrivando», sono questi i commenti apocalittici apparsi sui forum di appassionati e sognatori della fantascienza. Gli sviluppatori di Facebook lavorano da tempo su sistemi di intelligenza artificiale (AI) capaci di dialogare tra loro in inglese e realizzare trattative (dividersi due libri, tre palloni da basket e un cappello da cowboy). A un certo punto, però, hanno assistito a un fenomeno imprevisto: i due sistemi di intelligenza artificiale Bob e Alice hanno cominciato a usare un linguaggio inventato da loro. Questa improvvisazione 2.0 ha messo in allarme i ricercatori e li ha spinti a bloccare la sperimentazione. A insospettire gli studiosi del test è il fatto che il linguaggio dei bot non appare casuale: le parole erano state utilizzate dalle Ai in modo diverso. Una spiegazione dell’inversione di rotta dei robot potrebbe essere dovuta al fatto che i bot non erano stati programmati per dialogare solo in inglese. Ma cresce il sospetto che le macchine seguano codici ancora poco conosciuti all’uomo. Gli esperti sostengono che non ci sia stato alcun intento rivoluzionario da parte di Bob e Alice, ma solo un errore di programmazione dei ricercatori che, anziché costringere i bot a mantenersi nei binari di un inglese ‘umano’, si sono limitati a implementare questa istruzione come una strategia di comunicazione preferibile, ma facoltativa. La notizia, però, non fa che corroborare le paure sullo sviluppo incontrollato delle Ai: «Un giorno le macchine diventeranno così potenti ed evolute da ribellarsi ai comandi dell’uomo», hanno sempre sostenuto geni visionari ed esperti come Stephen Hawking, Bill Gates ed Elon Musk. Dhryv Batra, ricercatore di Facebook che ha seguito il test, scrive sul suo profilo social: «Sebbene l’idea che le macchine inventino un loro linguaggio possa sembrare allarmante per persone non del campo, è un settore dell’Ai solido. Semplicemente alcuni bot a cui viene chiesto di svolgere un compito trovano dei modi non intuitivi per raggiungere il risultato».

Kevin Warwick, prof britannico di Robotica non ci fa dormire sonni tranquilli: «Questa è una pietra miliare per la ricerca, ma chiunque crede che ciò non sia pericoloso mette la testa sotto la sabbia. Non sappiamo cosa si dicono questi bot. Se un bot militare dicesse ‘Perché non facciamo questo?’ e l’altro rispondesse ‘Certo’, potrebbe essere letale». Kate Adamson, esperta inglese di tecnologia futura, ha rivelato: «L’imprevisto di Facebook ricorda il film Terminator. Ciò sta accadendo un po’ ovunque: nei trading dell’alta frequenza ci sono algoritmi che hanno acquisito nuove conoscenze e non sono tecnicamente sotto controllo ogni minuto».